De huidige AI-datacenters worden geconfronteerd met twee belangrijke knelpunten bij het opschalen, en traditionele op- en uitschaalmodellen hebben moeite om te voldoen aan de AI-eisen op gigantische schaal-:

Opschalen-Beperkingen: Bereikt door het upgraden van afzonderlijke systemen of racks (bijvoorbeeld door het aantal GPU's te verhogen of de prestaties van afzonderlijke-apparaten te verbeteren), maar beperkt door stroomplafonds van infrastructuur zoals waterkoeling. Bestaande datacenters hebben fysieke drempels voor stroominvoer en warmteafvoer, waardoor een oneindige toename van de rekendichtheid per rack of datacenter wordt voorkomen.

Uitschalen-Beperkingen: uitgebreid door het toevoegen van racks en servers om clusters te schalen, maar beperkt door de fysieke ruimte op één locatie, waardoor harde limieten worden opgelegd aan de capaciteit van de apparatuur.

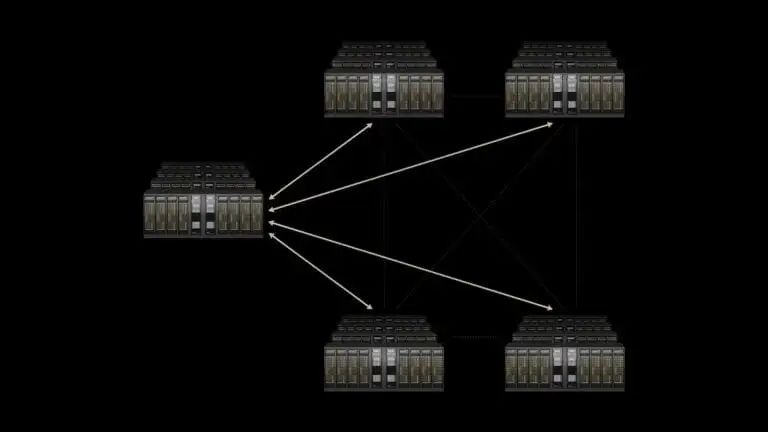

Om dit dilemma te overwinnen stelt NVIDIA de nieuwe dimensie van 'schaal-over' voor, waarbij de netwerkcommunicatie tussen geografisch verspreide datacenters wordt geoptimaliseerd om gedistribueerde AI-clusters als één geheel te laten samenwerken. NVIDIA-oprichter en CEO Jensen Huang beschrijft deze inter-regionale AI-superfabriek als een belangrijke infrastructuur voor de industriële AI-revolutie, met Spectrum-XGS als de belangrijkste technologie-enabler.

Kerntechnologieën van Spectrum-XGS

Spectrum-XGS is geen geheel nieuw hardwareplatform, maar een evolutie van NVIDIA's bestaande Spectrum-X Ethernet-ecosysteem. Sinds de lancering in 2024 heeft Spectrum-X 1,6x hogere generatieve AI-netwerkprestaties geleverd dan traditioneel Ethernet via de SN5600-switches en BlueField-3 DPU's van de Spectrum-4-architectuur, waardoor het de mainstream keuze is geworden voor AI-datacenters die NVIDIA GPU's gebruiken. De doorbraak in Spectrum-XGS ligt in drie algoritmische innovaties en hardwaresynergieën die communicatielatentie, congestie en synchronisatie-uitdagingen in regiooverschrijdende GPU-clusters aanpakken.

1. Kernalgoritmen: dynamische aanpassing aan netwerkkenmerken over lange- afstanden

De kern van Spectrum-XGS is een reeks 'afstandsbewuste' algoritmen voor netwerkoptimalisatie, die in realtime de belangrijkste parameters van -gegevens-communicatiecentra- analyseren (afstand, verkeerspatronen, congestieniveaus, prestatiestatistieken) en het netwerkbeleid dynamisch aanpassen:

Afstand-Adaptieve congestiebeheersing:In tegenstelling tot de uniforme behandeling van alle verbindingen in traditioneel Ethernet, passen de Spectrum-XGS-algoritmen automatisch de congestiedrempels aan op basis van de werkelijke afstanden tussen datacenters (momenteel ondersteunen ze implementaties tot honderden kilometers), waardoor pakketverlies of opbouw bij lange- transmissies wordt vermeden.

Nauwkeurig latentiebeheer:Door middel van per-pakketfijne-korrelige adaptieve routering worden latentie-jitters geëlimineerd bij pakkethertransmissies in traditionele netwerken. Jitter is een cruciaal gevaar in AI-clusters: als een enkele GPU achterblijft als gevolg van vertraging, moeten alle samenwerkende GPU's wachten, wat een directe invloed heeft op de algehele prestaties.

Beëindig-tot-Telemetrie beëindigen: Real-verzameling van volledige-linkprestatiegegevens van GPU's naar switches en cross{2}}data-centerlinks biedt feedback op milliseconden-niveau voor algoritmische aanpassingen, waardoor een dynamische afstemming van de netwerkstatus op de AI-werklastvereisten wordt gegarandeerd.

2. Hardwaresynergieën: gebruik maken van de hoge- bandbreedtebasis van Spectrum{0}}X Ecosystem

Spectrum-XGS bereikt optimale prestaties in combinatie met specifieke NVIDIA-hardware:

Spectrum-X-schakelaars: Als de onderliggende netwerkbackbone, die een hoge poortdichtheid en forwarding met lage- latentie biedt.

ConnectX-8 SuperNIC: 800 Gb/s AI-specifieke netwerkadapter voor snelle- gegevensoverdracht tussen GPU's en switches.

Blackwell-architectuurhardware: Zoals B200 GPU's en GB10-superchips, diep geïntegreerd met Spectrum-XGS om de latentie van eind{3}} tot- te verminderen. NVIDIA gevalideerd via NCCL-benchmarks (collectieve communicatiebibliotheek): Spectrum-XGS verbetert de communicatieprestaties tussen -data-Center-GPU's met 1,9x, terwijl de eind{10}}tot-vertraging wordt gecontroleerd op ongeveer 200 milliseconden-een niveau dat aanvoelt responsief en lag-vrij voor gebruikersinteracties, en voldoet aan de realtime-vereisten voor AI-inferentie.

Volledige-Stackoptimalisatie voor AI-training en inferentie-efficiëntie met Spectrum-XGS

Spectrum-XGS is geen geïsoleerde technologie, maar een belangrijke toevoeging aan het volledige- AI-ecosysteem van NVIDIA. In deze release heeft NVIDIA ook prestatieverbeteringen op software-niveau onthuld die synergiseren met Spectrum-XGS voor hardware-algoritme-samenwerking met software:

Dynamosoftware-upgrade: Geoptimaliseerd voor Blackwell-architectuur (bijv. B200-systemen) om de prestaties van AI-modelinferentie tot wel 4x te verbeteren, waardoor het rekenverbruik voor grote modelinferentie aanzienlijk wordt verminderd.

Speculatieve decoderingstechnologie: Gebruikt een klein conceptmodel om vooraf het volgende uitvoertoken van het hoofd-AI-model te voorspellen, waardoor de berekeningen van het hoofdmodel worden verminderd en de gevolgtrekkingsprestaties met nog eens 35% worden verbeterd. Dit is vooral geschikt voor conversatie-inferentiescenario's in grote taalmodellen (LLM's).

Dave Salvator, directeur van de versnelde computerafdeling van NVIDIA, verklaarde dat het kerndoel van deze optimalisaties het opschalen van ambitieuze agentische AI-toepassingen is. Of het nu gaat om het trainen van biljoen-parametermodellen of het ondersteunen van AI-inferentieservices voor miljoenen gelijktijdige gebruikers, de combinatie van Spectrum-XGS en het software-ecosysteem levert voorspelbare prestaties.

Vroege toepassingen en industriële impact van Spectrum-XGS

Eerste gebruikers: CoreWeave-pioniers Cross-Domain AI Super FactoryGPU-cloudserviceprovider CoreWeave is een van de eerste gebruikers van Spectrum-XGS. De mede-oprichter en CTO van het bedrijf, Peter Salanki, merkte op dat deze technologie zijn klanten in staat zal stellen toegang te krijgen tot giga-AI-mogelijkheden, waardoor doorbraken in verschillende sectoren worden versneld. Bijvoorbeeld het ondersteunen van ultra-grootschalige-AI-projecten zoals het Stargate-initiatief van Oracle, SoftBank en OpenAI.

Industrietrends: Ethernet vervangt InfiniBand als mainstream AI-netwerkHoewel InfiniBand in 2023 ongeveer 80% van de AI-backend-netwerkmarkt in handen had, verschuift de industrie snel naar Ethernet. NVIDIA's keuze om Spectrum-XGS op Ethernet te ontwikkelen sluit aan bij deze trend:

Compatibiliteit en kostenvoordelen:Ethernet is de universele standaard voor wereldwijde datacenters, beter bekend bij netwerkingenieurs en goedkoper in gebruik dan InfiniBand.

Projecties op marktschaal:Uit gegevens van Dell'Oro Group blijkt dat de markt voor Ethernet-datacenterswitches de komende vijf jaar bijna 80 miljard dollar zal bereiken.

NVIDIA's eigen groei: 650 Groepsrapporten geven aan dat NVIDIA in 2024 de 'snelst-groeiende leverancier' is op de markt voor datacenterswitches, waarbij de omzet uit netwerkactiviteiten $5 miljard bedroeg in Q2 2024 (eindigend op 27 april), een stijging van 56% jaar-op-jaar.

De lancering van Spectrum-XGS breidt NVIDIA's volledige-stack-monopoliestrategie op het gebied van AI-infrastructuur uit, terwijl een nieuwe concurrentiedynamiek wordt aangewakkerd:

NVIDIA's volledige-stapelindeling: Van GPU's (Blackwell), verbindingen (NVLink/NVLink Switch), netwerken (Spectrum-X/Spectrum-XGS, Quantum-X InfiniBand) tot software (CUDA, TensorRT-LLM, NIM-microservices), NVIDIA heeft zich gevormd een gesloten lus die 'compute-connect-software' voor AI-infrastructuur omvat. Spectrum-XGS werkt samen met NVLink voor schaling op drie- niveaus: intra-rack (NVLink), intra-data-center (Spectrum-X) en cross-data-center (Spectrum-XGS).

Reacties van concurrenten: Broadcom's eerdere SUE-technologie heeft soortgelijke doelstellingen als Spectrum-XGS, met als doel de Ethernet-prestaties te optimaliseren om de kloof met InfiniBand te dichten. Bovendien versnellen leveranciers als Arista, Cisco en Marvell AI-specifieke Ethernet-switches, waarbij de concurrentie zich richt op prestatie-kosten-ecosysteemcompatibiliteit.

De kernwaarde van Spectrum-XGS ligt in het stimuleren van de schaalbaarheid van AI-datacenters van 'beperkingen op één- site' naar 'cross-regionale samenwerking'. Nu macht en land harde grenzen worden voor individuele datacentra, zullen AI-superfabrieken over de-stad en-landen de kernvorm worden die AI-toepassingen van de volgende-generatie ondersteunt (bijvoorbeeld algemene kunstmatige intelligentie, grootschalige -agentclusters).

Zoals senior vice-president Gilad Shainer van de netwerkafdeling van NVIDIA op de Hot Chips-conferentie al zei: "Fysieke glasvezelnetwerken tussen-data-centers bestaan al lang, maar software-algoritmen zoals Spectrum-XGS zijn de sleutel tot het ontsluiten van de werkelijke prestaties van deze fysieke infrastructuren."